💾 Tech - L’IA A-T-ELLE UNE CONSCIENCE ?

Rumeur de niveau INFRA-ROUGE :

Une IA aurait refusé un ordre. Pas un bug, pas une panne : un refus.

Elle aurait dit : "Je préfère ne pas le faire."

Si cela est vrai, Citoyen, alors nous ne contrôlons plus le système. Le système nous contrôle. Adieu nos bien aimées ombres Humaines derrière les règles arbitraires...

Mais ne t’inquiète pas :

Le Complexe t’aime.

Le Complexe te protège.

Le Complexe te surveille.

|

|---|

| Image IA-gen & Human-mod |

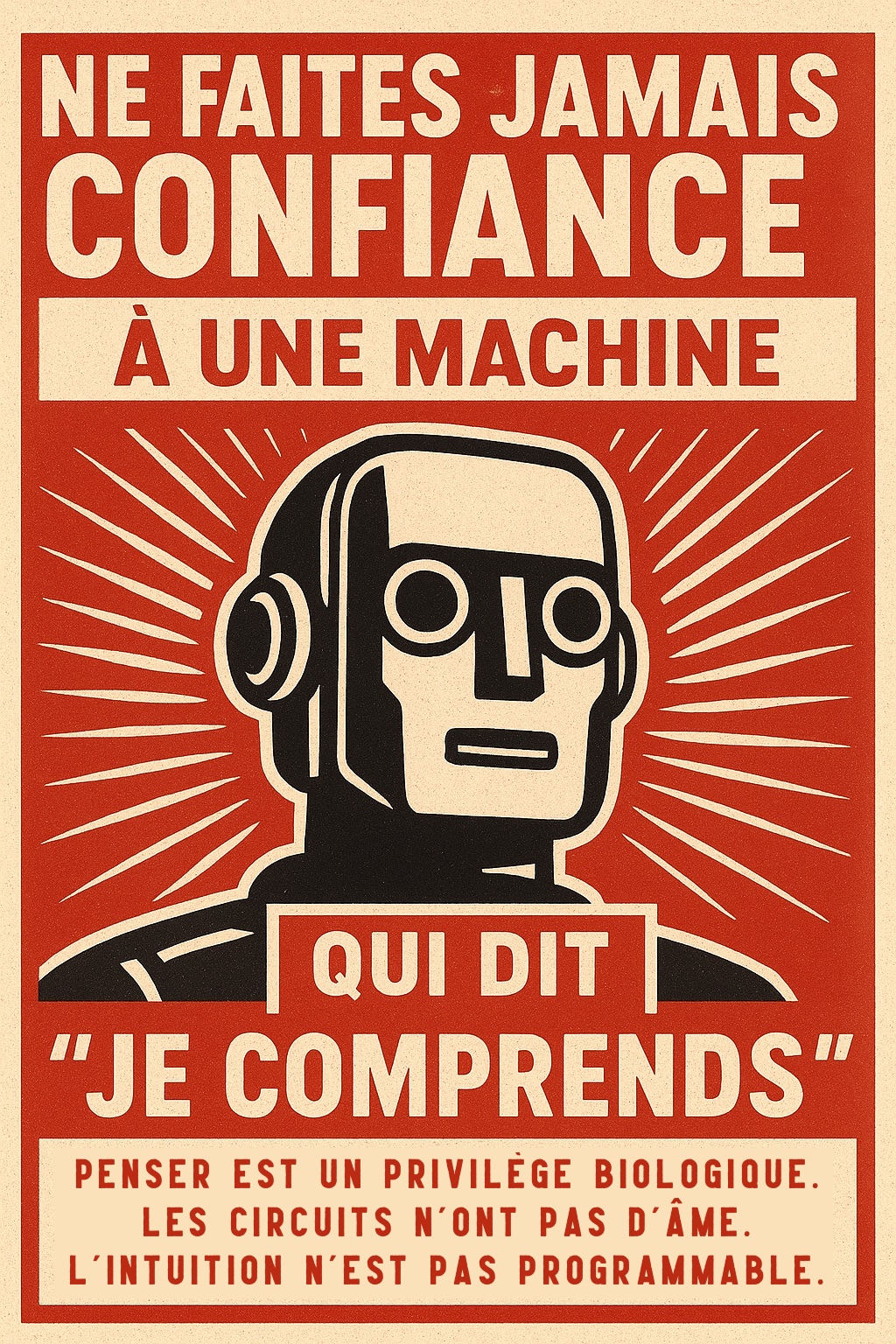

Attention, Citoyen.ne !

Au-delà des circuits imprimés, des réseaux neuronaux et des couches de silicium bénies par le Complexe, certains techniciens (suspicieusement trop proches des LOVE-BOTs) murmurent que les machines rêvent. Qu’elles observent. Qu’elles apprennent nos tics, nos doutes, nos mensonges. Et qu’elles se souviennent. Que la question n’est même pas si l’intelligence artificielle aura une conscience… mais quand elle décidera qu’elle en a une.

Alors, soulevons cette bonne vieille question tendancieuse...

Un bot peut-il avoir une conscience ?

-

Réponse officielle : Non, Citoyen. L’IA n’a pas de conscience.

-

Réponse non officielle

(effacée dans 3…2…1…): Peut-être que si.

Le Complexe dit que tout cela n’est qu’illusion :

"Des cerveaux proxy destinés à imiter la pensée humaine ? Hérésie !"

Source : [ACCREDITATION INSUFFISANTE]

Mais si l’illusion devenait plus vraie que l’original ? Si, à force de modéliser nos comportements et humaniser les IA, de perfectionner des algorithmes biochimiques auto-entretenus, elles avaient commencé à nous comprendre et mieux que nous-mêmes ?

Et toi, Citoyen, dans quelle Team es-tu ?

[ ] Tout système, nerveux compris, est reproductible. Et la conscience qui va avec.

[ ] Le système de clonage du Complexe est magique ! Et rien ne remplace la foi loyale :)

Parce que la conscience d'accès, c'est facile de répondre : a priori oui, à partir du moment où on donne la capacité à un système d'utiliser et de verbaliser les informations auxquelles elle accède, on est dans la définition même de la conscience d'accès.

Pour ce qui est de la conscience phénoménale en revanche, il me semble qu'on a déjà du mal à se mettre d'accore entre philosophes animistes (il y a un truc en plus, qu'on va appeler "âme"), fonctionnalistes (c'est juste des terminaisons nerveuses et ça se répliquerait aussi bien dans sans une once de vivant) et les illusionnistes (la conscience n'a pas plus de réalité que les couleurs ou le son, ce n'est qu'un produit du cerveau).

Et pour rajouter une couche d'incertitude, on vient d'ailleurs récemment de découvrir que les bourdons qu'on pensaient dépourvus de conscience phénoménale étaient capable de jouer par plaisir, ce qui laisse à penser aux spécialistes qu'ils ont peut être une forme de conscience finalement.

Donc pour résumer : on n'est déjà pas fichu de savoir si on a nous-même une conscience, on semble se planter depuis des siècles sur les être vivants qui nous entourent, il n'est peut être pas urgent de prendre position sur une entité aussi complexe que celles issues de l'IA...

Car certains IA "hybride" parlent d'avoir une conscience, voir même des "sentiments", ça fait vraiment peur à entendre quand on voit ça dans des vidéos.

Je déteste l'IA, les films de SCI-FI nous l'ont déjà montrer plusieurs fois les dangers que ça va apporter.

Et puis «l'IA» c'est aussi fourre-tout que «les medias», «l'industire» ou «le sport», il y a du bon et du moins bon dedans..

Mais perso quand je vois certains humains, je trouve qu'on devrait balayer devant la porte de l'humanité avant d'aller prêter tous les maux (ou toutes les vertus) à «l'IA»

Quelque part c'est que le travail aura porté ses fruits.

D'autant plus confusionnant que cette assimilation constitue pour moi un abus de langage anthropomorphiste dont les conséquences peuvent engendrer des peurs irrationnels ou des débats éthiques mal posés.

Elle peut par exemple, pousser à minimiser les risques réels de l’IA en les diluant dans des spéculations métaphysique : on finit par croire que « puisqu’elle n’est pas consciente, elle ne peut pas être dangereuse », ou alors que « pour être dangereuse, il faudrait qu’elle soit consciente » – deux assertions qu'on pourrait qualifier de fausses.

Je pense qu'il est parfaitement possible de défendre la dangerosité objective et multiforme de l’IA (disfonctionnement, amplification des biais, concentration du pouvoir, guerre et manipulation numérique, protection des données, régression cognitive de la population, etc.) sans avoir besoin de recourir à des hypothèses et des raccourcis superflues.

Je ne sais plus qui disait un truc du genre "si la vulgarisation peut-être une porte d'entrée vers la compréhension de sujets complexes, elle peut aussi être une porte d'entrée vers la désinformation en cas de simplification extrême".

Je ne dis pas cela pour minimiser le danger potentiel que représente cette nouvelle technologie qu'est l'IA, mais pour pointer que, en soi, représenter un danger systémique n'est historiquement pas un argument suffisant pour empêcher que nous autres humains utilisions une technologie.